80% aller KI-Projekte scheitern. Das hat die RAND Corporation 2024 ermittelt, doppelt so hoch wie die Fehlerquote klassischer IT-Projekte. Ein Jahr später sieht es noch schlechter aus: MIT's NANDA-Studie (2025) zeigt, dass 95% der GenAI-Piloten keinen messbaren ROI liefern. Die Zahl ist nicht besser geworden. Sie ist schlechter geworden.

Das Überraschende ist nicht die Zahl. Das Überraschende ist der Grund.

Denn es liegt nicht an der Technologie. Nicht am Fachkräftemangel. Auch nicht am Budget. Das eigentliche Problem beginnt früher. Viel früher. Und es ist ein Problem, das kaum jemand auf dem Radar hat: die fehlende Klarheit darüber, welches Problem überhaupt gelöst werden soll.

Ich nenne es das Spezifikationsproblem: Unternehmen schaffen es nicht, das zu lösende Problem klar zu benennen, bevor sie ein Tool evaluieren.

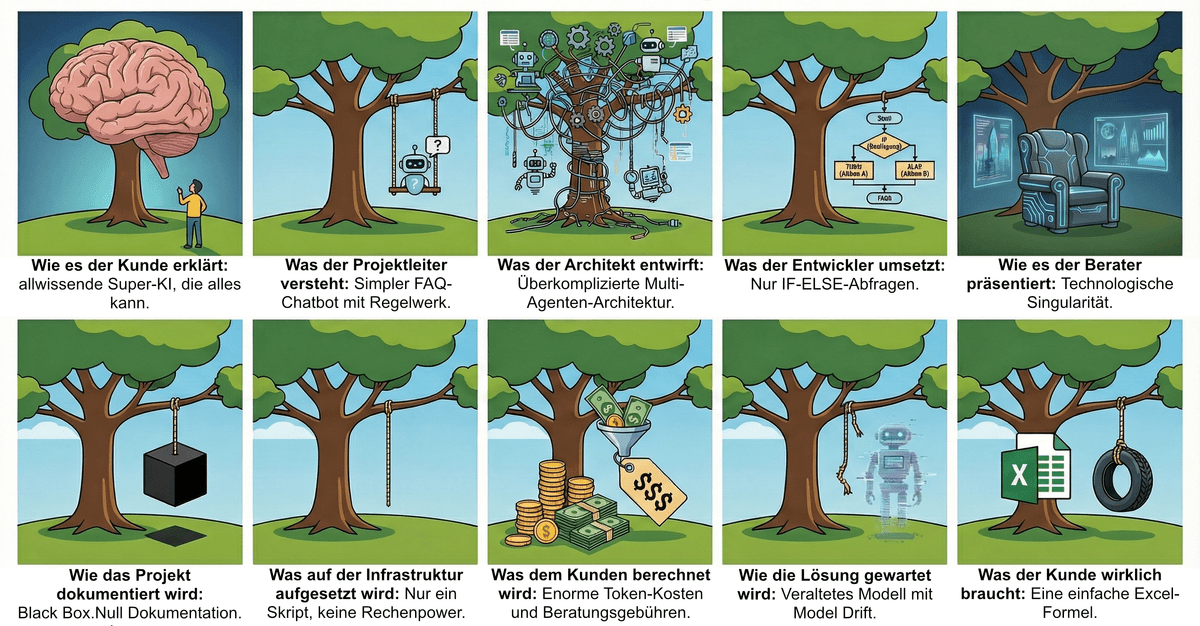

Die "Tree Swing"-Karikatur zeigt seit den 1970ern, wie Projekte scheitern, wenn jede Rolle dasselbe Vorhaben anders versteht. Hier neu interpretiert für KI-Projekte: Links oben steht, was der Kunde beschreibt. Rechts unten, was er tatsächlich braucht. Dazwischen liegen acht verschiedene Interpretationen. Genau das ist das Spezifikationsproblem.

Die üblichen Verdächtigen und warum sie nur Symptome sind

Wenn KI-Projekte scheitern, werden schnell die bekannten Gründe genannt. Schlechte Datenqualität. Fehlende Fachkräfte. Mangelndes Change Management. Zu komplexe Infrastruktur.

Alles richtig. Aber nur die halbe Wahrheit.

Diese Faktoren sind Symptome, nicht Ursachen. Sie greifen erst, wenn das Projekt bereits läuft. Das Budget ist freigegeben, der Tech-Stack steht, die ersten Daten werden gesammelt.

Zu diesem Zeitpunkt ist die Weiche für das Scheitern oft schon gestellt.

Die RAND-Studie hat Hunderte gescheiterte KI-Projekte analysiert und die häufigsten Ursachen nach Relevanz sortiert. An erster Stelle steht nicht "fehlende Daten" oder "schlechte Modelle". An erster Stelle steht: Falsche Problemdefinition. Die Forscher formulieren es so: "Misunderstandings and miscommunications about the intent and purpose of the project are the most common reasons for AI project failure."

Was bedeutet das? Das Team baut die falsche Lösung. Für das falsche Problem. Mit den falschen Zielen.

KI-Implementierung im Mittelstand: Wo das eigentliche Problem liegt

Das Spezifikationsproblem beschreibt einen Fehler, der fast immer in der Projektplanung passiert: Die Beteiligten können das zu lösende Problem nicht so beschreiben, dass eine Lösung daran gemessen werden kann. Das Problem wird zu abstrakt formuliert ("Wir wollen effizienter werden"), zu technisch definiert ("Wir brauchen ein LLM für den Kundenservice") oder gar nicht erst hinterfragt ("Die Konkurrenz nutzt KI, wir auch").

Die Folge: Das Projekt startet ohne Zielgröße, ohne Klarheit über den Status Quo und ohne Definition dessen, was "Erfolg" bedeuten würde.

Der typische Ablauf sieht so aus: Ein mittelständisches Unternehmen hört von ChatGPT, Claude oder einem KI-Tool aus der Branche. Es bildet sich die Überzeugung: "Das brauchen wir auch." Ein Budget wird beantragt, ein Pilot gestartet. Die zentrale Frage lautet: "Welches KI-Tool brauchen wir?"

Das ist die falsche Frage.

Die richtige Frage wäre: "Welches Problem lösen wir überhaupt?" Und zwar nicht abstrakt, sondern so, dass man es messen kann. Welcher Prozess kostet wie viel Zeit? Wo entstehen Fehler? Was würde sich im Alltag ändern, wenn die Lösung funktioniert?

Fehlt diese Klarheit, passiert immer das Gleiche:

- Vages Framing: "Wir wollen KI im Kundenservice einsetzen", aber welches Problem genau? Wartezeiten? Ticketvolumen? Erstlösungsrate?

- Falsche Datensammlung: Ohne klares Problem werden die falschen Daten gesammelt. Oder die richtigen Daten, aber in der falschen Granularität.

- Kein Nutzennachweis: Wenn die Zielgröße nicht definiert ist, kann auch kein ROI berechnet werden. Das Projekt dümpelt vor sich hin.

- Abbruch: Nach 6-12 Monaten wird das Projekt eingestellt. "KI funktioniert bei uns nicht."

Gartner prognostiziert, dass bis 2026 60% der KI-Projekte aufgegeben werden, weil die Datenbasis nicht stimmt. McKinsey's State of AI 2025 bestätigt: Nur 39% der Unternehmen berichten überhaupt einen EBIT-Effekt durch KI, und bei den meisten liegt er unter 5% des Gesamtergebnisses.

Das Problem ist kein technisches. Es ist ein Denkproblem.

RAND fasst es so zusammen: "Focus on the problem, not the technology. Chasing the latest and greatest advances in AI for their own sake is one of the most frequent pathways to failure."

Ein Beispiel aus meiner Beratungspraxis: Ein Fertigungsunternehmen mit rund 200 Mitarbeitern kam auf mich zu mit dem Wunsch nach einer "KI-gestützten Predictive Maintenance-Lösung". Budget: 150.000 Euro. Nach ein paar Tagen Analyse stellte sich heraus: Das eigentliche Problem war nicht fehlende Vorhersage, sondern fehlende Dokumentation der bisherigen Wartungshistorie. Die Daten existierten in Excel, auf Papier, in E-Mails. Sie waren nur nicht abrufbar. Die Lösung? Ein standardisiertes Excel-Template, ein Prozess zur Pflege und ein Dashboard zur Auswertung. Kosten: 15.000 Euro. Dauer: 4 Wochen. Ergebnis: ungeplante Stillstände sanken um 30%. Kein Machine Learning. Kein KI-Modell. Nur Klarheit über das tatsächliche Problem.

KI-Projekte im Mittelstand: Warum mehr Budget das Problem verschlimmert

Hier wird es kontraintuitiv. Man könnte meinen: Wenn mehr Geld in KI fließt, müssten die Erfolgsquoten steigen. Das Gegenteil ist der Fall. Die Zahlen werden von Jahr zu Jahr schlechter.

S&P Global hat 2025 über 1.000 Unternehmen befragt: 42% haben die meisten ihrer KI-Initiativen eingestampft. 2024 waren es noch 17%. In einem einzigen Jahr hat sich die Abbruchquote mehr als verdoppelt. Die durchschnittliche Organisation verwirft inzwischen 46% ihrer Proof-of-Concepts bevor sie in Produktion gehen.

Gleichzeitig fließt mehr Geld als je zuvor. Gartner rechnet 2026 mit weltweiten KI-Ausgaben von 2,5 Billionen Dollar. Aber weniger als 30% der KI-Verantwortlichen berichten, dass ihre CEOs mit dem Return on Investment zufrieden sind. Das Geld fließt, der Nutzen nicht.

Warum? Weil das Budget an der falschen Stelle landet. Gartner stellte fest, dass 54% der Unternehmen ihre KI-Investitionen um 30-40% unterschätzen, weil sie Integration, Datenaufbereitung und Change Management nicht einpreisen. Wichtige Komponenten, keine Frage. Aber wenn die Problemdefinition von Anfang an falsch war, wird auch die beste Integration das Projekt nicht retten.

Die RAND-Studie zeigt, dass spezialisierte, fokussierte Projekte zu 67% gelingen. Eigenentwicklungen ohne klaren Scope dagegen nur zu 33%. Der Unterschied? Klarheit über das Problem.

RAND bringt es auf den Punkt: "In some cases, leaders understand AI only as a buzzword and do not realize that simpler and cheaper solutions are available."

Im deutschen Mittelstand zeigt sich das besonders deutlich. Die KI-Studie 2025 belegt: 86% der KMUs erkennen die Relevanz von KI, aber nur 23% haben ein Projekt erfolgreich umgesetzt. Und die Investitionen sinken sogar: 2025 gaben Mittelständler nur noch 0,35% ihres Umsatzes für KI aus, 2024 waren es noch 0,41%. Der Druck, "jetzt auch KI zu machen", ist hoch. Aber die ersten Ergebnisse haben enttäuscht, und jetzt wird gebremst.

Das muss nicht sein. Was funktioniert: Eine strukturierte KI-Potenzialanalyse, die zuerst die schmerzhaftesten Prozesse identifiziert und dann prüft, ob KI überhaupt die richtige Antwort ist.

Weniger Tool. Mehr Denken.

Vom Pilotfriedhof zur Produktion: Was erfolgreiche KI-Projekte anders machen

Selbst wenn ein KI-Projekt den Piloten überlebt, heißt das noch nicht, dass es in die Produktion geht. Und der nächste Trend zeichnet sich bereits ab: Gartner prognostiziert, dass über 40% der Agentic-AI-Projekte bis Ende 2027 eingestellt werden. Die meisten davon sind heute noch frühe Experimente, getrieben von Hype statt von klarem Bedarf.

Warum bleiben Piloten stecken?

Kein ROI-Nachweis ist der häufigste Grund. Wenn die Zielgröße von Anfang an vage war ("effizienter werden"), kann auch nach dem Piloten kein Nutzen gezeigt werden. Die Geschäftsleitung gibt kein Budget für den Rollout frei.

Dazu kommt fehlende Skalierungsstrategie. Der Pilot funktioniert in der Testumgebung, aber niemand hat sich Gedanken gemacht, wie die Lösung auf 50 Standorte ausgerollt wird. Oder wie sie in die bestehenden Systeme integriert wird.

Und schließlich: Technology-First-Denken. Die RAND-Studie listet das "Technology-First-Mindset" auf Platz 3 der Hauptursachen. Das Team verliebt sich in die Technologie und vergisst das ursprüngliche Problem.

Was machen erfolgreiche KI-Projekte anders? McKinsey's State of AI 2025 liefert eine klare Antwort: Unternehmen mit EBIT-Effekt durch KI haben dreimal häufiger ihre Workflows neu gestaltet bevor sie ein Modell ausgewählt haben. Erst das Problem verstehen, dann die Lösung bauen. Die RAND-Synthese bestätigt das mit fünf Faktoren:

- Problem-First: Klare, messbare Problemdefinition vor Technologieauswahl

- Spezialisierung: Fokussierte Projekte mit klarem Scope statt "KI überall"

- Einfachheit: Bevorzugung simpler Lösungen gegenüber komplexen Modellen

- Interdisziplinäre Teams: Fachbereich und IT arbeiten eng zusammen, nicht in Silos

- Iterative Validierung: Frühzeitige Tests mit echten Nutzern, nicht erst am Ende

Ich ergänze aus eigener Erfahrung: Vendor-Neutralität. Die besten Projekte entstehen, wenn die Lösung nicht durch den Tech-Stack eines bestimmten Anbieters vordefiniert ist, sondern sich aus dem Problem ergibt. Das ist auch der Grund, warum ich keine Tools verkaufe. Ich habe zu oft gesehen, wie der "Hammer" die Problemdefinition verzerrt.

Was das für Ihr Unternehmen bedeutet

Sie planen ein KI-Projekt? Oder Ihr Pilot kommt nicht voran? Dann stellen Sie sich diese Fragen:

Können Sie das Problem in einem Satz beschreiben? Wenn die Antwort länger als 20 Sekunden dauert oder mit "Also, es ist komplex..." beginnt, haben Sie ein Spezifikationsproblem.

Haben Sie eine Zielgröße, die Sie messen können? "Effizienter werden" ist keine Zielgröße. "Antwortzeit im Support von 4 auf 2 Stunden senken" schon.

Würde eine einfachere Lösung auch funktionieren? Fragen Sie sich ehrlich: Brauchen Sie wirklich KI, oder wäre ein sauberer Prozess ausreichend?

Arbeiten Fachbereich und IT gemeinsam an der Definition? Wenn IT das Projekt alleine definiert, wird es am Bedarf vorbeigehen. Wenn nur der Fachbereich definiert, wird es technisch nicht umsetzbar sein.

Haben Sie die ersten drei Rollout-Standorte bereits identifiziert? Wenn nicht, denken Sie noch im Piloten-Modus. Erfolgreiche Projekte planen Skalierung von Tag 1.

Wissen Sie, was passiert, wenn das Projekt scheitert? Das klingt negativ, zwingt aber zu Klarheit: Wenn Sie die Opportunitätskosten nicht benennen können, war das Problem nie wichtig genug.

In den 20+ KI-Projekten, die ich begleitet habe, war der Unterschied zwischen Erfolg und Scheitern fast nie technischer Natur. Es war immer Klarheit. Über das Problem, über die Ziele, über den Nutzen.

Wenn Sie vor einem KI-Projekt stehen und unsicher sind, ob die Problemdefinition trägt, oder wenn Ihr Pilot seit Monaten nicht vorankommt, kann ein externer Blick helfen. Nicht von jemandem, der Ihnen ein Tool verkaufen will. Sondern von jemandem, der die richtigen Fragen stellt.

Unsere Digitale Standortbestimmung ist genau dafür gebaut. Sie enthält eine vollständige KI-Potenzialanalyse: Welche Prozesse tatsächlich problematisch sind, wo KI sinnvoll wäre und wo nicht. Das Ergebnis ist kein Pitch-Deck, sondern eine Entscheidungsgrundlage mit konkreten Use Cases, ROI-Einschätzungen und einer Roadmap für Ihr Unternehmen. Sie arbeiten direkt mit mir als Senior-Berater. Und Sie bekommen eine ehrliche Antwort, auch wenn die lautet: "Für dieses Problem brauchen Sie keine KI."

Wenn Sie bereits wissen wo KI helfen soll und einen Piloten umsetzen wollen, unterstütze ich Sie hands-on in der Pilot-Umsetzung.

Denn die teuerste KI-Investition ist die, die das falsche Problem löst.