Die falsche Frage

Die meisten fragen: ChatGPT oder Claude? Sonnet oder Opus? Das Modell von OpenAI, Google oder Anthropic? Das ist die falsche Frage. Die richtige liegt darunter: Wo laufen diese Modelle, und wem gehören dabei die Daten?

Laut einer BCG-Studie vom Juni 2025 nutzen 67% der deutschen Arbeitnehmer KI regelmäßig am Arbeitsplatz. 54% geben an, KI auch ohne Genehmigung ihres Arbeitgebers nutzen zu wollen, wenn es den Alltag erleichtert. Schatten-KI in industriellem Maßstab. Bitkom 2026 zeigt parallel: 8% der deutschen Unternehmen verzeichnen bereits verbreitete Schatten-KI-Nutzung, doppelt so viele wie 2024. 36% der Unternehmen setzen KI aktiv ein. Welches Tool die Mitarbeiter nutzen, weiß die IT vielleicht. Wohin die Daten fließen, weiß niemand.

Im letzten Jahr haben sich drei Dinge verändert, die zusammen ein neues Risikobild ergeben. Eines, das die meisten KMU-Entscheider noch nicht auf dem Schirm haben:

- Das BGH-Urteil vom 27. März 2025 hat die Spielregeln geändert. DSGVO-Verstöße sind jetzt wettbewerbsrechtlich abmahnbar. Nicht nur durch Behörden, sondern durch Mitbewerber.

- Die großen Cloud-KI-Anbieter haben Ende 2025 still und ohne großes Aufsehen ihre Standardeinstellungen fürs Training geändert. Wer kostenlose oder günstige Tarife nutzt, teilt seitdem standardmäßig mehr als früher.

- Ab 02. August 2026 greifen die EU AI Act Transparenzpflichten. Was heute noch in einer Grauzone liegt, wird dann bußgeldbewehrt.

Das ergibt ein Bild, das unbequem ist: Mitarbeiter geben Kundendaten, Kalkulationen und interne Dokumente in KI-Tools ein, die diese Eingaben bei vielen Anbietern inzwischen auch zum Training der Modelle nutzen. Das Unternehmen weiß es oft nicht. Und wenn der Konkurrent das herausfindet, kann er seit März 2025 direkt abmahnen.

Die Modell-Frage ist eine Komfort-Frage. Wo die KI läuft, ist eine Haftungs-Frage. In diesem Artikel erkläre ich, warum. Und was konkret zu tun ist.

KI Cloud DSGVO: Das BGH-Urteil vom 27.03.2025 ändert die Spielregeln

Am 27. März 2025 hat der Bundesgerichtshof zwei Urteile gesprochen, die für KI-Nutzer in Unternehmen weitreichende Folgen haben. Aktenzeichen I ZR 222/19 und I ZR 223/19, ursprünglich entschieden im Kontext von Online-Marktplätzen: DSGVO-Verstöße sind seit diesem Datum grundsätzlich wettbewerbsrechtlich über das UWG abmahnbar. Nicht nur Behörden können einschreiten. Mitbewerber können direkt abmahnen.

Was bedeutet das konkret für KI-Nutzer? Wenn ein Unternehmen KI-Tools einsetzt und dabei gegen die DSGVO verstößt, etwa durch fehlende Datenschutzerklärung zur KI-Nutzung, fehlenden Auftragsverarbeitungsvertrag nach Art. 28, nicht dokumentierte Trainingsnutzung oder unzureichende Information der Betroffenen, dann kann der Konkurrent nebenan abmahnen lassen. Nicht die Aufsichtsbehörde. Der Wettbewerber.

Abmahnkosten liegen erfahrungsgemäß bei 3.000 bis 10.000 Euro. Rechtsverteidigung kostet weitere 5.000 bis 20.000 Euro. Dazu kommt Reputationsschaden, der sich schlecht quantifizieren lässt. Kein hypothetisches Szenario sondern das neue Spielfeld.

In Geschäftsführerrunden sehe ich das immer noch zu wenig auf dem Schirm. Die Wahrnehmung ist: "DSGVO ist ein Behörden-Thema." das war sie vielleicht einmal. Seit März 2025 ist sie ein Business-Risiko, das in die gleiche Kategorie fällt wie Wettbewerbsverstöße bei Werbung oder AGB-Fehler.

Den Kontext liefern die Bußgeld-Zahlen der letzten Monate. Der HmbBfDI hatte bis Ende September 2025 bereits 775.000 Euro Bußgelder verhängt. Darunter 492.000 Euro gegen ein einzelnes Finanzunternehmen, wegen automatisierter Ablehnungsentscheidungen ohne ausreichende Transparenz über die Entscheidungslogik nach Art. 22 DSGVO. Nah am Thema KI: Wer automatisierte Entscheidungen über Personen trifft, ohne die gesetzlich vorgeschriebenen Schutzmaßnahmen, zahlt bereits jetzt.

So sieht Datenschutz-Durchsetzung 2025 aus. Direkter und teurer als noch vor zwei Jahren.

Ein unvollständiger Satz zur KI-Nutzung in der Datenschutzerklärung. Ein fehlender AVV mit dem Cloud-Anbieter. Eine Mitarbeiterin, die Kundendaten in ChatGPT eingibt, ohne dass dies dokumentiert ist. Ein Entwickler, der Code mit Kundendaten in Copilot wirft, ohne zu wissen, was damit passiert. Jeder dieser Punkte kann seit März 2025 rechtliche Konsequenzen haben.

DSGVO-Compliance bei KI ist keine Formalität, die man mit einem Compliance-Template abarbeitet. Sie ist eine Architekturentscheidung. Und die beginnt bei der Frage, wo die KI läuft.

Genau das ist KI Cloud DSGVO: Die rechtliche Lage hat sich verschoben, aber die meisten KMU arbeiten noch mit einer Logik aus vergangenen Jahren.

Cloud-Anbieter und KI Cloud DSGVO: Die stillen Änderungen 2025 und 2026

Das ist der Abschnitt, dem die meisten Unternehmen noch nicht genug Aufmerksamkeit geschenkt haben. Ende 2025 haben mehrere große KI-Anbieter ihre Standard-Einstellungen geändert. Nicht mit großen Ankündigungen. Nicht mit Opt-In-Aufforderungen. Still, per Popup oder aktualisierter Nutzungsbedingung.

Anthropic, 28. September 2025. Claude-Nutzer in den Consumer-Tiers (Free, Pro, Max) wurden mit einer neuen Wahl konfrontiert: Training auf Nutzungsdaten erlauben oder nicht. Wer das Popup vor Oktober 2025 bestätigt hat, ohne es genau zu lesen, oder seither aktiv zugestimmt hat, liefert seine Konversationen mit einer Retention von fünf Jahren statt der vorherigen dreißig Tage. Eine 60-fach längere Datenspeicherung. Seit dem 8. Oktober 2025 ist der Standard-Default beim Popup auf Opt-Out gesetzt. Aber wer schon vorher zugestimmt hatte, bleibt im Training-Modus, und viele wissen das nicht.

OpenAI ChatGPT (Free, Plus, Pro). Das Opt-Out-Modell ist seit Beginn die Grundlage. Training auf Konversationen ist Default. Die Chat-Historie wird unbegrenzt gespeichert, solange Nutzer sie nicht manuell löschen. Das entsprechende Setting muss aktiv gesucht werden. Beim Onboarding gibt es keinen expliziten Hinweis, dass Konversationen als Trainingsmaterial dienen.

Google Gemini, seit 02. September 2025. Free und Advanced wurden auf Opt-Out umgestellt. Nutzer-Uploads werden standardmäßig zur Modellverbesserung genutzt. Default-Retention: 18 Monate. Die "Keep Activity"-Einstellung ist für eingeloggte Nutzer automatisch aktiv. Seit März 2026 verbindet die Personal-Intelligence-Funktion Gemini zusätzlich mit Gmail, Google Photos, YouTube-Historie und Google Search, zunächst in den USA. Google betont, diese persönlichen Daten würden nur referenziert, nicht direkt zum Training verwendet. Für Unternehmen im DACH-Raum eine Zusicherung, die rechtlich schwer zu prüfen ist.

Meta AI, seit 16. Dezember 2025. Die schärfste Variante. Training plus Ad-Targeting per Default. Und: Es gibt keinen Opt-Out-Toggle. Wer Meta AI über Facebook oder Instagram nutzt, hat keine Kontrollmöglichkeit über die Verwendung seiner Eingaben.

GitHub Copilot, ab 24. April 2026. Training-Default für Free und Pro wird aktiviert. Betroffen sind besonders Entwickler in Unternehmen, die Copilot im Alltag nutzen und möglicherweise Unternehmenscode, Kommentare und interne Logik in ein Trainingssignal einfließen lassen. Business- und Enterprise-Tiers sind ausgenommen.

Die Ausnahme: Microsoft 365 Copilot Enterprise mit Enterprise Data Protection (EDP). Hier greift ein anderes Regime. Mit EDP werden Prompts, Antworten und Graph-Daten nicht für Training genutzt. Es gibt Tenant-Isolation, DSGVO-Zusicherungen, ein vollständiges Data Protection Addendum nach Art. 28, Verschlüsselung bei Speicherung und Übertragung sowie Compliance-Zertifikate (ISO 27001, HIPAA, ISO 42001). Microsoft hat hier die klare Trennlinie gezogen: Consumer vs. Business.

Consumer-Tiers im Überblick (Stand April 2026):

- OpenAI ChatGPT (Free/Plus/Pro): Training per Default, unbegrenzte Retention, Opt-Out in Settings möglich

- Google Gemini (Free/Advanced): Training seit 09/2025, 18 Monate Retention, Opt-Out über Keep Activity

- Anthropic Claude (Free/Pro/Max): Wahl seit 09/2025, 5 Jahre Retention wenn Training aktiv, sonst 30 Tage, Opt-Out möglich

- Microsoft Copilot (Consumer): Training per Default, 90 Tage Retention, Opt-Out über Activity-Settings

- Meta AI (Facebook/Instagram): Training plus Ad-Targeting, unbegrenzte Retention, kein Opt-Out

- GitHub Copilot (Free/Pro): Training ab 24.04.2026, unbegrenzte Retention, Opt-Out möglich

Zum Vergleich die APIs der gleichen Anbieter: OpenAI trainiert nicht auf API-Daten. Anthropic hat bei der API 7 Tage Log-Retention und keine Training-Nutzung, mit Zero-Data-Retention als Option. Der Unterschied ist klar: Die APIs sind strikter als die Consumer-Produkte, weil sie an Business-Verträge gekoppelt sind. Wer die API von OpenAI nutzt, ist in einer anderen Lage als jemand, der ChatGPT Plus nutzt, auch wenn es das gleiche Modell im Hintergrund ist.

Was diese Tabelle zeigt, ist keine Skandalliste. Es ist die nüchterne Beschreibung des Status quo. Wer mit Consumer-Tiers arbeitet, hat ein potenzielles Datenabfluss-Risiko, auch ohne es zu bemerken. Für die Mitarbeiterin, die ChatGPT Free für Kundenkommunikation nutzt. Für den Entwickler, der Copilot im kostenlosen Tarif für Code-Reviews einsetzt. Für den Vertriebsmitarbeiter, der Angebote in Gemini formuliert. Für jeden, der unbewusst Produkt- oder Kundenwissen in eine dieser Eingabemasken schreibt.

Die Daten in diesen Tools sind nicht mehr nur Anfragen. Sie sind potenziell Trainingsmaterial. Ein Datenschutzproblem, ja. Aber seit dem BGH-Urteil vom März 2025 auch ein Haftungsproblem im Sinne des BGH-Urteils.

Was bereits passiert ist: Vier dokumentierte Vorfälle

Es ist verlockend, Datenrisiken bei Cloud-KI als hypothetisch zu behandeln. "Uns passiert schon nichts." Ich höre das häufig. Die Realität sieht anders aus. Dokumentiert, nicht spekulativ.

Samsung Source-Code-Leak, März 2023. Drei separate Vorfälle innerhalb von drei Wochen: Ein Mitarbeiter gab fehlerhaften Datenbankcode in ChatGPT ein. Ein anderer Optimierungs-Code für Fehlererkennung. Ein dritter nahm eine Meeting-Aufnahme und ließ sie transkribieren und zusammenfassen. Alles in OpenAIs Consumer-Infrastruktur. Samsung verhängte daraufhin ein generelles Nutzungsverbot für KI-Tools. Nicht weil irgendjemand böswillig gehandelt hätte. Sondern weil die Mitarbeiter nicht wussten, was mit ihren Eingaben passiert. Das Unternehmen wollte das Risiko weiterer Vorfälle nicht tragen.

ChatGPT Redis-Bug, März 2023. In einem 9-Stunden-Fenster konnten 1,2% der Plus-Subscriber Zahlungsdaten anderer Nutzer sehen: Namen, E-Mail-Adressen, Postadressen, die letzten vier Ziffern der Kreditkarte, das Ablaufdatum. Ursache war eine Race-Condition in einer Open-Source-Redis-Bibliothek. Keine böswilligen Akteure. Ein technisches Versagen in einer externen Abhängigkeit, die OpenAI genutzt hat. Und: Einige Nutzer sahen Titel aus Chats anderer Nutzer, neben Zahlungsdaten also auch Konversationsinhalte.

Mixpanel-Sicherheitsvorfall, November 2025. Mixpanel, ein Analytics-Vendor von OpenAI, wurde über eine SMS-Phishing-Kampagne kompromittiert. Angreifer verschafften sich ab dem 8. November Zugang zu Kundendaten der OpenAI-Plattform. Exponiert wurden Namen, E-Mail-Adressen, Standorte und technische Systemdetails von API-Nutzern (BleepingComputer). Nicht von Consumer-Nutzern. Von zahlenden Plattform-Kunden. Der Punkt: Selbst wer für ein Business-Tier zahlt, hat keine Kontrolle darüber, welche Dritt-Vendoren der Anbieter nutzt und wie sicher diese sind.

Search-Engine-Indexing-Leak, Juli/August 2025. OpenAI führte experimentell eine "Discoverable"-Funktion ein, mit der Nutzer geteilte ChatGPT-Konversationen für Suchmaschinen indexierbar machen konnten. Über 4.500 Chats landeten in Google-Suchergebnissen. Darunter vermutlich auch personenbezogene Daten und Geschäftsinformationen. Das Problem: Die Funktion war so gestaltet, dass viele Nutzer gar nicht verstanden, dass ihre Chats damit öffentlich auffindbar wurden. OpenAI zog das Feature am 1. August 2025 zurück (TechCrunch, Search Engine Land).

Diese vier Fälle zeigen zusammen, dass Cloud-KI eine Haftungskette ist, nicht ein einzelnes technisches Risiko. Vier verschiedene Angriffsvektoren, vier verschiedene Ursachen, alle innerhalb von zweieinhalb Jahren, alle mit dokumentierten Folgen:

- Interner Nutzerfehler bei fehlender Schulung (Samsung). Kein Hack, sondern eine Lücke in der internen Steuerung.

- Technischer Fehler in einer externen Open-Source-Komponente (Redis). Der Anbieter selbst hat funktioniert. Ein Baustein in dessen System nicht.

- Sicherheitsvorfall bei einem Unterauftragnehmer (Mixpanel). OpenAI hatte zwar korrekte Verträge, aber diese haben die Datenpanne nicht verhindert.

- Designfehler mit öffentlicher Indexierung (Teilen-Funktion). Schlechte Benutzerführung statt Angriff.

Was alle vier gemeinsam haben: Das Unternehmen, dessen Daten abflossen, hatte zum Zeitpunkt des Vorfalls keinerlei Kontrolle mehr.

Für KMU heißt das: Der Moment, in dem Kundendaten in eine Cloud-KI eingegeben werden, ist der Moment, in dem Kontrolle abgegeben wird. Über Training, über die gesamte Dienstleisterkette, über die technischen Abhängigkeiten des Anbieters und dessen Voreinstellungen und Benutzerführung. Jeder dieser Punkte kann unabhängig voneinander scheitern. Und jedes Scheitern wird nach dem BGH-Urteil zum Haftungsrisiko.

Der US-Faktor: CLOUD Act, Schrems II und die Regierungs-Verträge

Der US CLOUD Act ist öffentliches Recht seit 2018. Er erlaubt US-Behörden den Zugriff auf Daten bei US-Unternehmen, unabhängig davon, wo die Server stehen. OpenAI, Google, Microsoft, Anthropic: alle betroffen. Für das typische mittelständische Unternehmen in DACH ist ein direkter Zugriff unwahrscheinlich. Die Behörden nutzen das Instrument selektiv, meist in Ermittlungsverfahren mit internationalem Bezug. Relevant ist etwas anderes: Die Rechtsgrundlage existiert, sie kollidiert mit der DSGVO, und falls das Data Privacy Framework vom EuGH für ungültig erklärt wird, entfällt die Rechtsgrundlage für alle EU-US-Datentransfers. Das betrifft dann auch Cloud-KI.

Schrems II und das Data Privacy Framework. Der EuGH kippte 2020 mit Schrems II das EU-US Privacy Shield. 2023 adoptierte die EU-Kommission das Data Privacy Framework (DPF) als neue Rechtsgrundlage für transatlantische Datentransfers. Im September 2025 wies der EU General Court eine erste Annullierungsklage (Latombe) ab. Das DPF überstand diese Runde. Aber eine EuGH-Berufung ist anhängig. Der EuGH hat Privacy Shield und sein Vorgänger-Modell bereits zweimal gekippt. Eine Compliance-Brücke, keine stabile langfristige Absicherung. Wer seine gesamte KI-Strategie darauf aufbaut, baut auf einer rechtlichen Grundlage, die sich erneut verschieben kann. Mit rückwirkenden Konsequenzen für bereits übertragene Daten.

OpenAI und das Pentagon, Juni 2025. OpenAI sicherte sich einen 200-Millionen-Dollar-Vertrag mit dem Chief Digital and Artificial Intelligence Office (CDAO) des US-Verteidigungsministeriums. Zweck: Admin-Prozess-Optimierung in den Bereichen Healthcare, Acquisition Data und Cyber Defense. OpenAI dokumentierte drei rote Linien: keine Massenüberwachung von US-Bürgern, keine Kontrolle autonomer Waffen, keine High-Stakes-Entscheidungen ohne menschliches Review.

Anthropic und das Verteidigungsministerium, Februar 2026. Verteidigungsminister Hegseth drohte Anthropic mit der Einstufung als "Risiko für die Lieferkette", nachdem Anthropic sich geweigert hatte, uneingeschränkte Zugangsbedingungen zu akzeptieren. OpenAI übernahm diesen Vertrag.

Diese Verträge zeigen eine enge Verflechtung zwischen US-KI-Anbietern und US-Verteidigungspolitik. Für europäische KMU ist das eine Rahmenbedingung, die bei der Anbieter-Wahl einkalkuliert werden sollte, unabhängig davon, wie wahrscheinlich ein direkter Zugriff im Einzelfall ist. Die Daten liegen in einem Rechtsraum, der andere Regeln hat als die DSGVO.

Was bedeutet das konkret für ein mittelständisches Unternehmen in DACH?

- Der CLOUD Act ist geltendes Recht und nicht verhandelbar. Wer Cloud-KI von US-Anbietern nutzt, nimmt dieses Risiko in Kauf.

- Das DPF ist die einzige vertragliche Basis, auf der personenbezogene Daten aktuell überhaupt rechtssicher in die USA fließen dürfen. Wenn das DPF kippt, müssen alle Auftragsverarbeitungsverträge mit US-Anbietern neu verhandelt werden.

- Lokale KI und europäische Anbieter wie Aleph Alpha oder Mistral entgehen diesem Risiko per Architektur. Die Produkte der US-Anbieter sind nicht schlechter — aber die Daten liegen in einem anderen Rechtsraum.

Für ein KMU mit sensiblen Kundendaten ist das keine theoretische Debatte mehr. Es geht um die Geschäftsgrundlage.

Die zweite Welle: EU AI Act ab 02. August 2026

Das BGH-Urteil hat das Abmahn-Risiko für bestehende DSGVO-Pflichten geöffnet. Der EU AI Act wird in vier Monaten eine zweite Compliance-Anforderung scharf schalten. Ab dem 02. August 2026 greifen die Art. 50 Transparenzpflichten: KI-generierte Texte, Bilder, Videos und Audioinhalte müssen als KI-generiert gekennzeichnet sein. Chatbots müssen als KI erkennbar sein. Deepfakes müssen als manipuliert gekennzeichnet werden. Die Bußgelder: Bis 15 Millionen Euro oder 3% des globalen Jahresumsatzes.

Art. 50 hat mehrere Adressaten. Absatz 1 verpflichtet Anbieter von KI-Systemen, die für direkte Interaktion mit Personen bestimmt sind, zur Offenlegung. Absatz 2 verpflichtet Anbieter, synthetische Inhalte (Text, Bild, Audio, Video) maschinenlesbar zu kennzeichnen. Absatz 4 regelt die Kennzeichnungspflicht für Betreiber: Deepfakes müssen als manipuliert gekennzeichnet werden, und KI-generierte Texte müssen als solche erkennbar sein, wenn sie "die Öffentlichkeit über Angelegenheiten des öffentlichen Interesses" informieren sollen. Für Produktbeschreibungen, Blog-Artikel und Marketing-Texte besteht diese spezifische Pflicht nach aktuellem Stand nicht. Trotzdem: Wer einen KI-gestützten Kundenchatbot auf der Website betreibt, fällt unter die Betreiber-Pflichten. Und die Compliance-Verantwortung trägt das verarbeitende Unternehmen, nicht der Modell-Anbieter.

Dann die Grauzone: KI-Entwurf plus menschliche Überarbeitung. Auch wenn die Text-Kennzeichnungspflicht aktuell eng gefasst ist, bleibt die Frage relevant. Der regulatorische Spielraum kann sich erweitern, und Reputationsrisiken bestehen unabhängig von der Rechtslage. Die zentrale Unsicherheit: Ab wann gilt ein Text als "KI-generiert"?

Der Draft Code of Practice der EU-Kommission (Dezember 2025, Finalisierung erwartet Juni 2026) unterscheidet zwei Kategorien: "fully AI-generated" (autonom erstellt, ohne menschliches Ausgangsmaterial) und "AI-assisted" (Mischform Mensch und KI). Eine prozentuale Schwelle, ab wie viel Überarbeitung ein Text nicht mehr als KI-generiert gilt, existiert nicht. Compliance-Juristen erwarten, dass substantielle redaktionelle Verantwortung als Ausnahmekriterium anerkannt wird. Der finale Code of Practice (erwartet Juni 2026) wird das konkretisieren. Schon jetzt zeichnet sich ab: Bloße Durchsicht wird nicht reichen. Die menschliche Bearbeitung muss den Inhalt tatsächlich formen, nicht nur freigeben.

Zur Nachweisbarkeit: Technisch ist das Thema noch ungelöst. Anders als bei Bildern (C2PA-Standard) gibt es für Text kein zuverlässiges Wasserzeichen. Googles SynthID manipuliert Token-Wahrscheinlichkeiten beim Generieren, doch nach Paraphrasierung oder Übersetzung fällt die Erkennungsrate auf Zufallsniveau. KI-Detektoren wie GPTZero oder Originality.ai werben mit hoher Genauigkeit, schneiden in unabhängigen Tests aber deutlich schwächer ab. Bei paraphrasiertem oder stark überarbeitetem Text sinkt die Trefferquote erheblich, und menschliche Texte werden regelmäßig fälschlich als KI-generiert eingestuft. Für einen rechtlichen Nachweis reicht das nicht.

Wer KI zur Erstellung von Texten und Inhalten einsetzt, sollte jetzt dokumentieren: Welche Inhalte mit KI-Unterstützung entstehen, wie der redaktionelle Prozess aussieht, also wer prüft, überarbeitet, freigibt und welche Kennzeichnung verwendet wird. Die Formulierung "Dieser Text wurde mit KI-Unterstützung erstellt und redaktionell überarbeitet" deckt sowohl die Transparenz als auch die Human-Review-Ausnahme ab. Keine gesetzliche Pflicht für die meisten KMU-Texte, aber die sicherste Position. Sie kostet nichts außer einer internen Prozess-Entscheidung.

Das klingt nach einem Problem für große Konzerne. Es ist auch eines für KMU, über die Kombination mit dem BGH-Urteil.

Zur Einordnung: DSGVO-Verstöße sind seit dem BGH-Urteil vom März 2025 durch Mitbewerber abmahnbar. Für den AI Act gibt es diese Rechtsprechung noch nicht, aber Compliance-Juristen rechnen damit, dass die gleiche Logik greift. Wenn das passiert, entsteht eine doppelte Angriffsfläche. Ein Konkurrent, der feststellt, dass ein Unternehmen KI-generierte Texte auf der Website verwendet, ohne diese zu kennzeichnen, und dabei DSGVO-Verstöße über die Cloud-KI-Nutzung im Hintergrund laufen, hat ab August 2026 ein deutlich schärfere Mittel in der Hand.

Der BfDI veröffentlichte im Dezember 2025 eine Handreichung "Datenschutz und KI in Behörden", die Signalwirkung für den Privatsektor hat: Datenschutz "von Anfang an" beim Einsatz von KI. Besondere Aufmerksamkeit für LLM-Training und Datenspeicherung. Die Richtung ist klar. Was für Behörden gilt, kommt in abgewandelter Form auch im Privatsektor an.

Zur Durchsetzung: 2025 gab es in Deutschland noch keine wegweisenden KI-spezifischen Bußgelder. Kein Entwarnungssignal. Eine Anlaufphase. Die Behörden bauen Expertise auf, die Gesetzgebung schärft sich, und in 2026 werden die ersten Fälle kommen.

Nichts davon ist ein Grund, KI nicht zu nutzen. Es ist ein Grund, sie richtig einzusetzen. Wer jetzt seine KI-Strategie für Datenschutz und Compliance aufstellt, hat noch Zeit. Wer wartet bis August 2026, muss unter Zeitdruck umbauen.

Die Alternative: Lokale KI

Ich könnte jetzt einen weiteren Compliance-Abschnitt schreiben. Stattdessen erkläre ich, warum lokale KI die einzige Antwort ist, die das Risikobild grundlegend ändert. Nicht flicken, sondern umbauen.

Was "lokal" technisch bedeutet: Das KI-Modell läuft auf Hardware im eigenen Unternehmen, ohne Verbindung zu externen KI-Diensten für die Verarbeitung von Anfragen. Kein Datentransfer nach außen. Keine Auftragsverarbeitung bei einem Cloud-Anbieter. Keine Dienstleisterkette. Die Ausschluss-Logik ist direkt: Der CLOUD Act greift nicht, weil keine Daten bei US-Unternehmen liegen. Risiken aus Auftragsverarbeitung nach Art. 28 entfallen, weil keine Daten nach außen gehen. Änderungen der Standardeinstellungen bei Anthropic, OpenAI oder Google sind irrelevant, weil das Modell lokal läuft. Sicherheitsvorfälle bei Dienstleistern wie Mixpanel betreffen das Unternehmen nicht, weil kein Dienstleister in der Kette ist. Die Teilen-Funktion von ChatGPT ist irrelevant, weil es nichts zu teilen gibt. Weniger Risiko? Nein. Eine andere Architektur, die diese Risikokategorien aus der Gleichung nimmt. Dafür entstehen andere Anforderungen: IT-Kompetenz, Hardware-Betrieb, Updates. Dazu weiter unten mehr.

Die Einstiegshürde ist deutlich niedriger als die meisten KMU-Entscheider vermuten. Open-Source-Modelle wie Llama oder Phi-4 laufen auf einem kompakten Desktop-PC mit handelsüblicher Grafikkarte. Ein Rechner mit 32 GB RAM, 1 TB SSD und einer aktuellen Grafikkarte kostet zwischen 1.000 und 2.000 Euro. Fertig konfiguriert mit KI-Software ist er produktionsfähig. Ausreichend für kleinere Teams bis etwa 15 bis 20 Mitarbeiter mit einfachen bis mittleren Anwendungsfällen. Für größere Mittelständler mit mehreren Abteilungen, parallelen Zugriffen und anspruchsvollerer Auslastung liegt die Hardware-Investition im mittleren fünfstelligen Bereich: dedizierter Server mit professioneller Grafikkarte, redundantem Speicher und Überwachung. Der Sprung ist begründet durch die Anforderungen, nicht durch Marketing. Lokal heißt auch: direkter Zugriff auf die eigenen Dokumente. Die Unternehmensdokumente, die Kundenliste, die Kalkulationen und die offenen Vorgänge, weil diese lokal indexiert sind. Keine Datenwolke. Kein Sync in die Cloud. Alles bleibt im Gebäude.

Ein durchgerechnetes Beispiel für KI Cloud vs. lokal Kosten. Nehmen wir ein mittelständisches Unternehmen mit 50 Mitarbeitern und sensiblen Kundendaten (Rechnungen, Verträge, Kalkulationen, Angebote).

Szenario A: Business-Cloud mit Microsoft 365 Copilot Enterprise, 30 Lizenzen à 28,10 Euro pro Monat (reguläre Zusatzlizenz, Stand April 2026, Basislizenz kommt hinzu), rund 845 Euro monatlich allein für Copilot, über 10.000 Euro jährlich. Plus Integration, Schulung, laufende Verwaltung.

Szenario B: Lokale KI mit dediziertem Server. Hardware einmalig etwa 8.000 bis 12.000 Euro. Einrichtung und Anpassung einmalig etwa 3.000 bis 5.000 Euro. Laufender Betrieb und Wartung etwa 400 bis 600 Euro monatlich.

Über drei Jahre gerechnet: Cloud etwa 32.000 Euro, Lokal etwa 25.000 bis 33.000 Euro. Die reinen Betriebskosten sind ähnlich. Der Unterschied liegt in der Haftungsbilanz: Bei der Cloud-Variante trägt das Unternehmen das Training-Risiko, das Risiko von Sicherheitsvorfällen beim Dienstleister, das CLOUD-Act-Risiko und die Abhängigkeit vom Data Privacy Framework. Eine einzige Abmahnung mit Rechtsverteidigung kann 15.000 bis 30.000 Euro kosten. Die Kostenposition, die in den meisten Gesamtkostenvergleichen fehlt. Für ein Kleinunternehmen mit 10 bis 15 Mitarbeitern sieht die Rechnung anders aus: Hier ist die Einstiegs-Hardware im niedrigen vierstelligen Bereich ausreichend, und die Amortisation gegenüber Cloud-Abonnements liegt oft bei 12 bis 18 Monaten.

Keine Theorie. Es gibt mehrere Anbieter im DACH-Raum, die fertige Lösungen mit betreutem Service anbieten. Mit dem HSLR Cube haben wir eine lokale KI-Lösung entwickelt, die genau das umsetzt: komplett on-premise, kein Internet für die KI-Verarbeitung notwendig, DSGVO-konform per Architektur. Eine on-premise KI für Unternehmen, die KI Datenschutz Compliance als Designprinzip behandeln, nicht als Zusatzaufwand. Integriert mit bestehenden Dokumenten und Systemen, zu planbaren Kosten. Für einen tieferen Einblick in on-premise KI für Unternehmen, Kosten, Arbeitsabläufe und Eigenbetrieb vs. betreuter Service sprechen Sie uns gerne direkt an.

Die Einschränkung gehört dazu. Lokale KI ist nicht für jeden Use Case die richtige Antwort. Der initiale Aufwand ist höher als eine Cloud-Anmeldung. IT-Know-how ist erforderlich oder muss zugekauft werden. Nicht jedes Modell läuft auf jeder Hardware. Und für einige Anwendungsfälle (sehr komplexe Analysen, hochspezialisierte Fachdomänen, große KI-Systeme mit vielen parallelen Aufgaben) sind aktuell Cloud-Modelle noch leistungsfähiger. Die Frage ist nicht "lokal oder Cloud?". Die Frage ist: Welche Daten verarbeite ich, und kann ich das Risiko einer Cloud-Architektur dafür verantworten?

Entscheidungs-Framework für KMU: Cloud oder lokale KI DSGVO-Konform?

Keine Theorie mehr. Drei Fragen, die jede Geschäftsführung jetzt beantworten sollte. Mit konkreten Szenarien, nicht abstrakt.

Frage 1: Wie sensibel sind meine Daten wirklich? Die wichtigste Frage, und sie wird am seltensten explizit gestellt.

Szenario A, hohes Risiko: Ein 40-Mitarbeiter-Pflegedienst mit Patientendaten, Diagnosen, Pflegeprotokollen. Hier ist Consumer-Cloud faktisch keine Option. Jede Eingabe personenbezogener Gesundheitsdaten in ChatGPT Free ist ein Art. 9 DSGVO-Verstoß. Die vertretbaren Wege: Microsoft 365 Copilot Enterprise mit EDP (mit vollständigem AVV und geprüften Zusicherungen zur Mandantentrennung) oder lokale KI. Kein anderer Weg hält einer DSGVO-Prüfung stand.

Szenario B, mittleres Risiko: Ein 80-Mitarbeiter-Maschinenbauer mit Kalkulationen, Lieferantenverträgen, Angeboten für Großkunden. Hier sind Geschäftsgeheimnisse das Risiko, nicht primär personenbezogene Daten. Business-Cloud mit starkem Auftragsverarbeitungsvertrag ist vertretbar. Lokale KI ist vorteilhaft wegen Schutz des geistigen Eigentums und weil Wettbewerber über US-Cloud theoretisch indirekt Zugang bekommen könnten (Training, Dienstleisterkette). Die Abwägung hängt von der Konkurrenz-Situation ab.

Szenario C, niedriges Risiko: Eine 15-Mitarbeiter-Marketingagentur, die KI für Blog-Entwürfe, Social-Media-Content und öffentliche Kampagnen nutzt. Consumer-Cloud mit Training-Opt-Out ist vertretbar, wenn die Eingaben keine vertrauliche Kundendaten enthalten. Die interne Schulung muss klar regeln, was rein darf und was nicht.

Frage 2: Kann ich Haftungsrisiken absorbieren? Eine Abmahnung durch einen Mitbewerber kostet erfahrungsgemäß zwischen 3.000 und 10.000 Euro, plus Rechtsverteidigung von weiteren 5.000 bis 20.000 Euro. Bei einem nachgewiesenen DSGVO-Verstoß mit Datenschutzbehörden-Beteiligung liegen die Zahlen höher. Die HmbBfDI-Bußgelder 2025 zeigen das. Dagegen gerechnet: Eine KI-Standortbestimmung mit Beratung und konkretem Plan liegt bei einem Bruchteil. Eine lokale KI-Lösung wie der Cube kostet im ersten Jahr weniger als zwei Abmahnungen mit Rechtsverteidigung. Eine einfache Rechnung, keine Verkaufsargumentation. Wer den Haftungsfall einpreist (was jedes solide Risikomanagement tut), kommt bei sensiblen Daten schneller bei der lokalen Lösung an, als die reine Betriebskostenrechnung suggeriert.

Frage 3: Welche Compliance-Anforderungen kommen auf mich zu? EU AI Act Art. 50 ab 02. August 2026 ist gesetzt. Vier Monate von jetzt. Wer dann noch KI-generierte Inhalte ohne Kennzeichnung veröffentlicht, ist abmahnbar. Dazu kommen branchenspezifische Anforderungen: Gesundheitswesen, Finanzdienstleistungen und Rechtsberatung stehen unter besonders scharfer Regulierung. Und: Ausschreibungen im B2B-Bereich verlangen zunehmend Nachweise zur Datenhoheit und DSGVO-Konformität. Wer keine saubere Antwort hat, verliert Aufträge. In einigen Branchen bereits Realität, nicht Prognose.

Drei Pfade, klar eingeordnet:

- Consumer-Cloud (ChatGPT Free/Plus, Gemini, Claude Pro): Für unkritische Inhalte und öffentliche Texte. Hohes Haftungsprofil (Trainings-Standard, CLOUD Act, Dienstleisterkette). Niedrige laufende Kosten, hohe Kosten im Schadensfall.

- Business-Cloud (z.B. Microsoft 365 Copilot Enterprise mit EDP): Für mittleres Risiko und Unternehmen mit sauberen Governance-Prozessen. Mittleres Haftungsprofil (kein Training, aber CLOUD Act bleibt, Auftragsverarbeitungsvertrag ist Grundlage). Mittel bis hohe laufende Kosten.

- Lokale KI (on-premise, z.B. HSLR Cube oder Eigenbau): Für hohes Risiko, sensible Daten und Unabhängigkeit. Niedriges Haftungsprofil (keine Dienstleisterkette, kein CLOUD Act, keine Trainings-Risiken). Mittel bis hohe Einmalkosten, niedrig laufend.

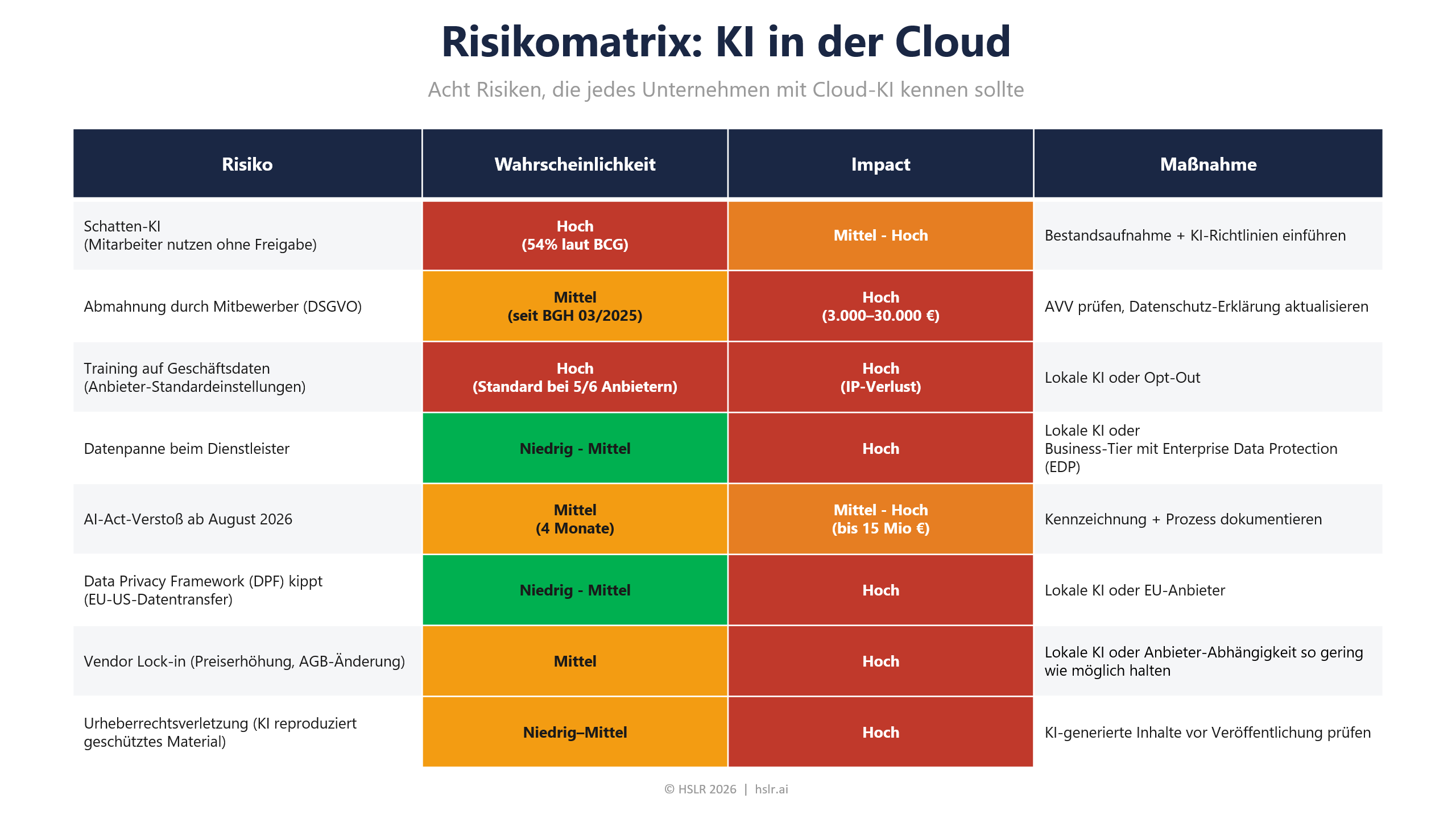

Wer die Risiken im Überblick sehen will, hier die vollständige Matrix:

Laut Bitkom 2026 nutzen erst 36% der deutschen Unternehmen KI aktiv. 47% planen oder diskutieren den Einsatz. Die Entscheidung, wo die KI läuft, prägt die KI Datenschutz Compliance des Unternehmens für die nächsten drei bis fünf Jahre. Sie rückwirkend zu korrigieren ist teurer (auch technisch, auch organisatorisch) als sie jetzt richtig zu treffen. Eine DSGVO-konforme KI-Lösung ist kein Luxus für Großunternehmen. Sie ist für KMU mit sensiblen Daten eine Grundvoraussetzung, wenn man im neuen Abmahn-Umfeld stabil bleiben will.

Was jetzt konkret zu tun ist

Die Modell-Debatte läuft weiter. Anthropic, OpenAI und Google werden neue Versionen rausbringen. Das wird nicht aufhören. Die Entscheidung Cloud oder lokal sollte aber nicht auf die lange Bank geschoben werden, denn die Kombination aus BGH-Urteil, veränderten Standardeinstellungen und AI Act ergibt ein Risikobild, das sich in den nächsten Monaten verschärft, nicht entspannt. Drei konkrete Schritte für jede Geschäftsführung:

Schritt 1: Bestandsaufnahme. Welche KI-Tools sind aktuell im Einsatz, inklusive Schatten-KI? Was die Mitarbeiter tatsächlich nutzen, nicht was offiziell genehmigt ist. Die BCG-Zahlen sind eindeutig: In Unternehmen ohne klare KI-Richtlinie nutzen mehr als die Hälfte der Mitarbeiter ohnehin KI, autorisiert oder nicht. Wissen schlägt Nicht-Wissen. Eine kurze, anonyme Umfrage plus Stichproben-Gespräche im Team liefern in zwei Wochen ein brauchbares Bild.

Schritt 2: Datenklassifizierung. Welche Daten fließen in diese Tools? Das geht nicht ohne eine ehrliche Kategorisierung: Was ist sensibel (personenbezogen, Gesundheit, Finanzen), was ist mittleres Risiko (Geschäftsgeheimnisse, Kalkulationen), was ist unkritisch (öffentlich, bereits publiziert)? Die Klassifizierung sollte mit dem Datenschutzbeauftragten und der IT gemeinsam gemacht werden. Ergebnis: eine Tabelle, die zeigt, welche Daten welches Risiko-Level haben.

Schritt 3: Entscheidung Cloud oder lokal. Welche Tools bleiben, welche werden durch Business-Tarife mit vernünftigem Auftragsverarbeitungsvertrag ersetzt, welche durch eine lokale Lösung? Diese Entscheidung sollte gemeinsam mit einer Tech-Beratung getroffen werden, die nicht an einem einzelnen Anbieter hängt. Anbieterneutrale Perspektive ist hier wichtig, weil jede Empfehlung, die zufällig zum Portfolio eines Anbieters passt, verdächtig ist.

Parallel zu den drei Schritten lohnt es sich, die eigene Datenschutzerklärung auf KI-Nutzung zu prüfen und bei Bedarf zu ergänzen. Die günstigste Absicherung gegen kurzfristige Abmahnungen und in wenigen Tagen erledigt, wenn man weiß, was man tut. Klingt nach mehr Arbeit als es ist, wenn es systematisch angegangen wird.

Die HSLR KI-Standortbestimmung dauert eine Woche. Am Ende liegt ein klares Bild vor: Welche KI-Tools werden aktuell genutzt, welche Daten fließen wohin, welche Anwendungsfälle das größte Potenzial haben, und welcher Weg (Consumer-Cloud, Business-Cloud oder lokal) passt zu den spezifischen Anforderungen des Unternehmens. Anbieterneutral. Kein Abo-Modell. Kein Lock-in.

Wer danach entscheidet, dass lokale KI der richtige Weg ist, integriert den HSLR Cube direkt. Wir begleiten die Umstellung bis in den produktiven Betrieb. Wer Business-Cloud bevorzugt, bekommt Unterstützung bei der Umstellung auf die richtigen Tarife und das passende Vertragswerk.

Die nächsten sechs Monate entscheiden, welche Unternehmen KI strategisch und rechtssicher einsetzen. Und welche sich mit einer schlecht dokumentierten Consumer-Cloud-Nutzung ins Abmahn-Risiko manövrieren. Die Frist, die BGH-Urteil und EU AI Act gemeinsam setzen.

Die Modell-Frage bleibt spannend. Über Haftung entscheidet sie nicht. Wo die KI läuft, schon. Und diese Frage gehört auf den Tisch.

Johannes Häußler ist Gründer von HSLR und berät KMU im DACH-Raum zu KI, Daten und Automatisierung. Er hat mehr als 20 KI-Projekte in Fertigung, Energie und IoT abgeschlossen und entwickelt mit dem HSLR Cube ein vorkonfiguriertes On-Premise-KI-System für den Mittelstand.

Quellen

- activemind.legal: BGH 27.03.2025 — DSGVO-Verstöße wettbewerbsrechtlich abmahnbar (I ZR 222/19 & I ZR 223/19)

- TechCrunch: Anthropic Terms-Änderung September 2025 — Training Default & 5-Jahre-Retention

- Anthropic Privacy Center: How long do you store my data?

- OpenAI Help: How your data is used to improve model performance

- Google Support: Gemini Apps Privacy Hub — Training, Retention, Opt-Out

- Microsoft Learn: Microsoft 365 Copilot Enterprise Data Protection

- TechCrunch: Samsung bans ChatGPT after Source-Code-Leak März 2023

- OpenAI: March 20 ChatGPT Outage Post-Mortem (Redis-Bug)

- OpenAI: Mixpanel Incident — Offizielles Statement

- BleepingComputer: OpenAI Discloses API Customer Data Breach via Mixpanel Vendor Hack

- Breaking Defense: OpenAI for Government — 200 Mio. USD Pentagon-Vertrag Juni 2025

- Fortune: Anthropic DoD-Situation Februar 2026 — OpenAI übernimmt Vertrag

- Jones Day: EU General Court upholds EU-US Data Privacy Framework (September 2025)

- TÜV Consulting: EU AI Act Art. 50 Transparenzpflichten ab 02.08.2026

- BCG: AI at Work 2025 — 67% Deutsche nutzen KI, 54% ohne Arbeitgeber-Zustimmung

- Bitkom: Studienbericht KI 2026 — 36% KI-Adoption, 8% Schatten-KI

- BfDI: Handreichung "Datenschutz und KI in Behörden" Dezember 2025

- Datenschutzticker: HmbBfDI — 775.000 EUR Bußgelder 2025, darunter 492.000 EUR Finanzunternehmen Art. 22